En este artículo se explora cómo un equipo de ingeniería backend implementó una solución escalable para automatizar el análisis de datos utilizando Airflow y Cloud Batch. A partir de una arquitectura basada en Snowflake, se optimizaron flujos de trabajo existentes y se incorporaron capacidades de cómputo intensivo. Este caso muestra cómo evolucionar desde pipelines tradicionales hacia plataformas modernas, manteniendo flexibilidad, eficiencia y escalabilidad.

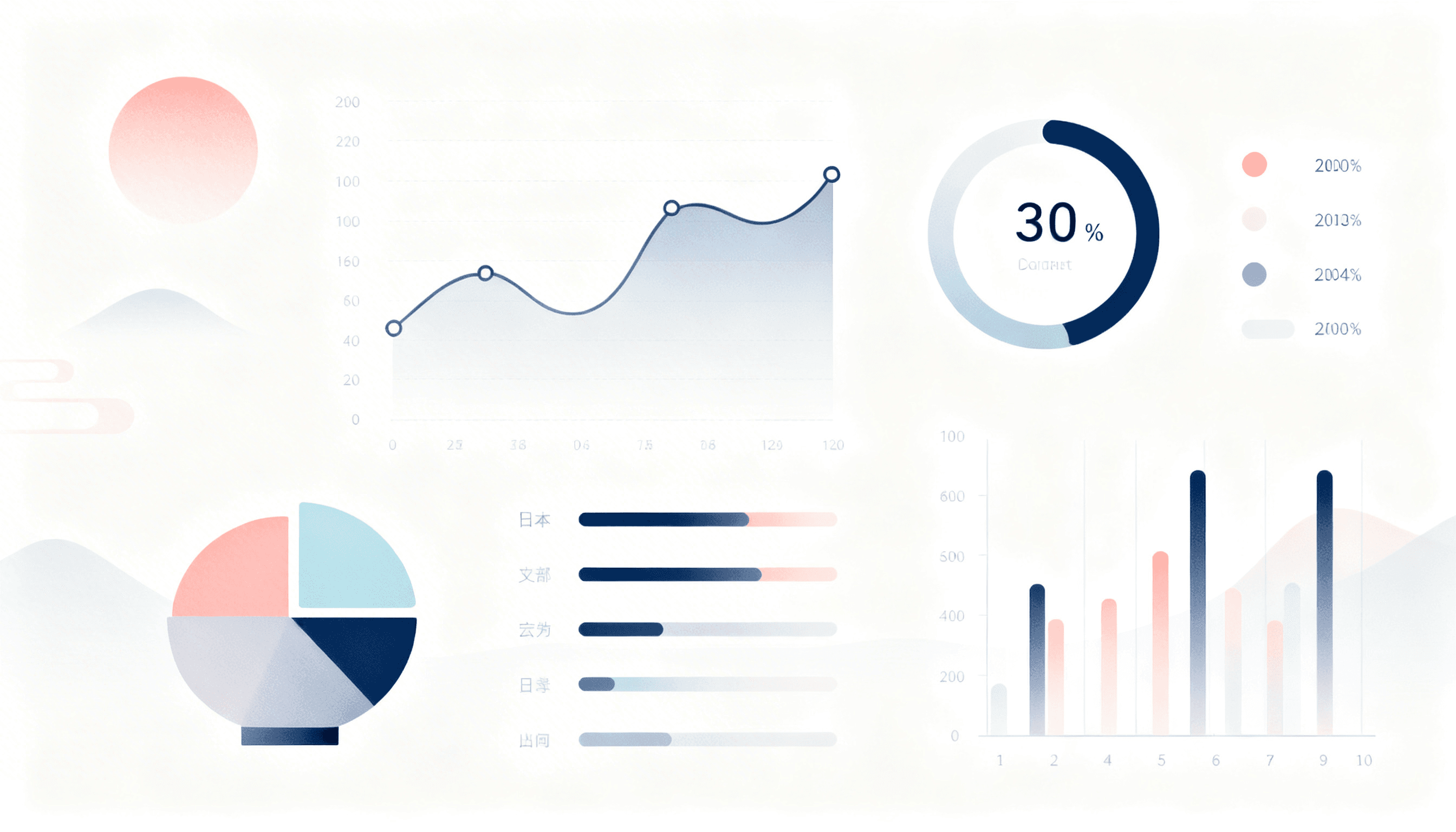

A medida que las organizaciones dependen cada vez más de los datos para tomar decisiones, los sistemas que los procesan deben evolucionar constantemente. Ya no es suficiente con ejecutar tareas programadas o generar reportes básicos; hoy se requiere soportar análisis complejos, grandes volúmenes de información y modelos avanzados.

En este contexto, surge el desafío de construir plataformas que no solo automaticen procesos, sino que también escalen de manera eficiente. Este artículo presenta cómo un equipo de ingeniería transformó su infraestructura de datos integrando herramientas modernas como Airflow y Cloud Batch, logrando una solución más flexible, potente y preparada para el crecimiento.

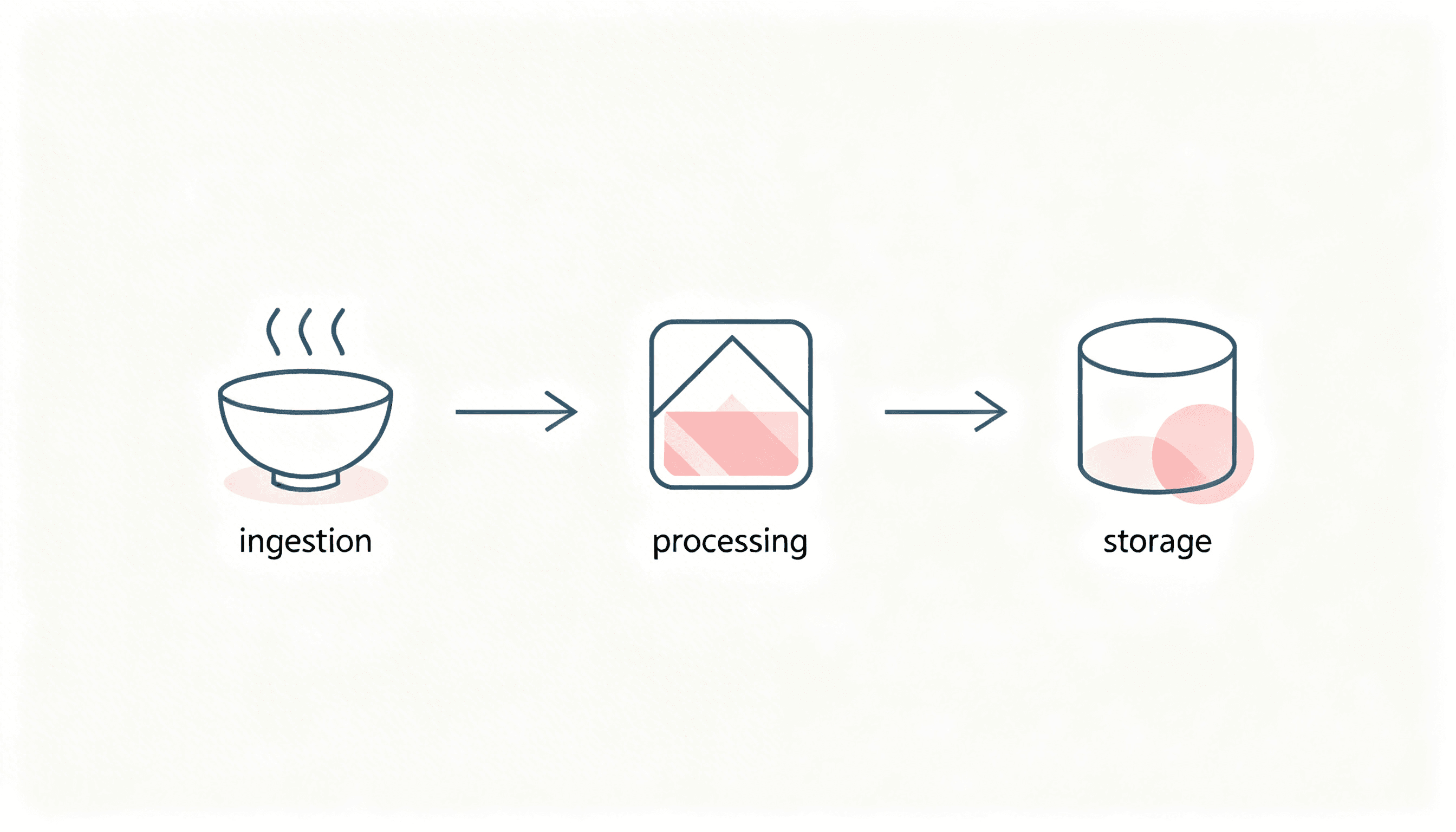

El sistema se construyó sobre una arquitectura de datos organizada en capas, lo que permite estructurar la información de manera eficiente y reutilizable. Estas capas incluyen desde la ingesta de datos hasta su consumo final para análisis.

Puntos clave:

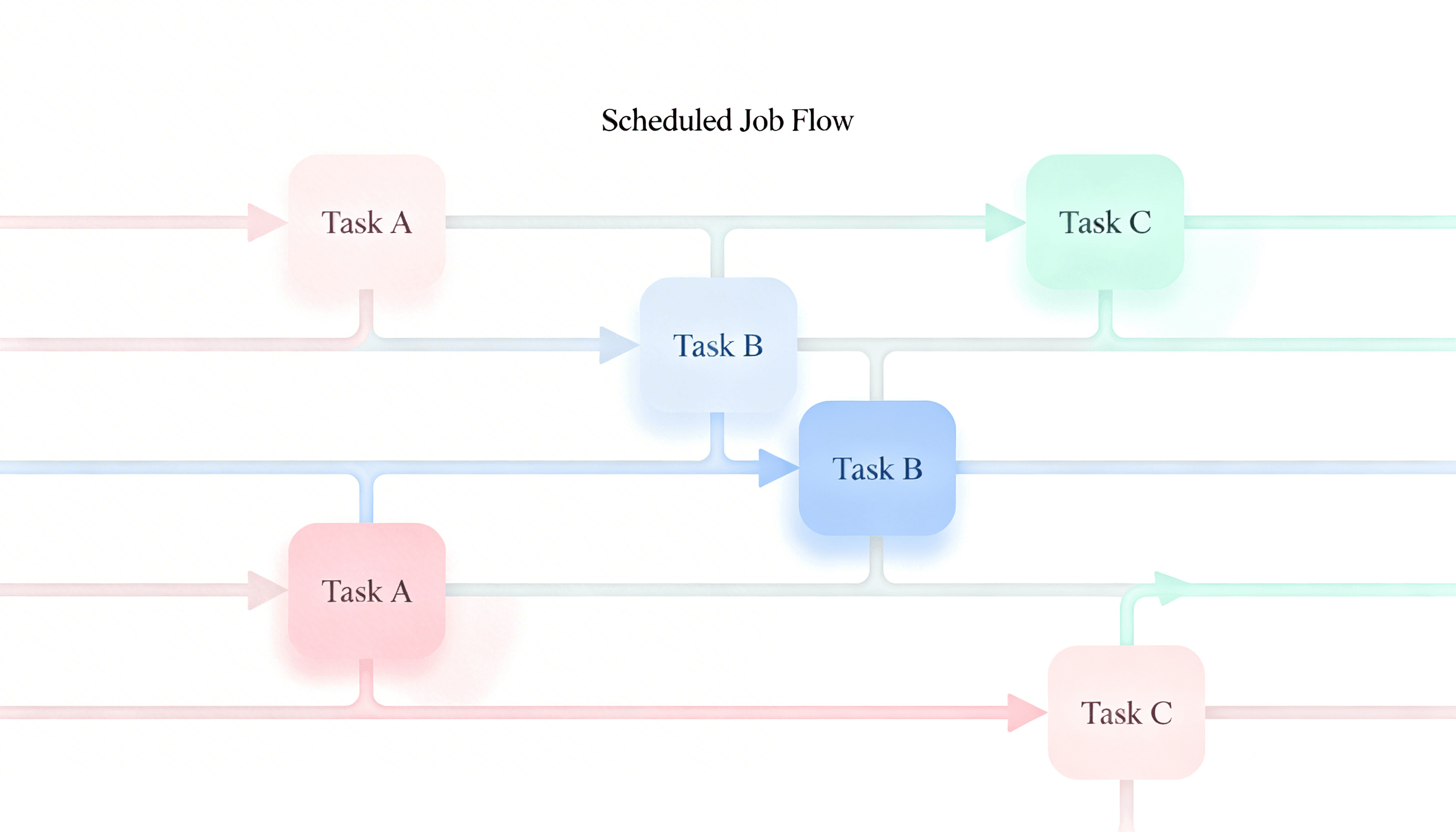

Además, la orquestación de procesos se centralizó utilizando Airflow, facilitando la programación y monitoreo de tareas.

Para gestionar los flujos de trabajo, se utilizó Airflow como motor principal de orquestación, permitiendo automatizar pipelines complejos. La transformación de datos se realizó con dbt, lo que simplifica el trabajo al permitir definir lógica directamente en SQL.

Puntos clave:

Esto permitió al equipo mantener un sistema organizado, flexible y fácil de escalar.

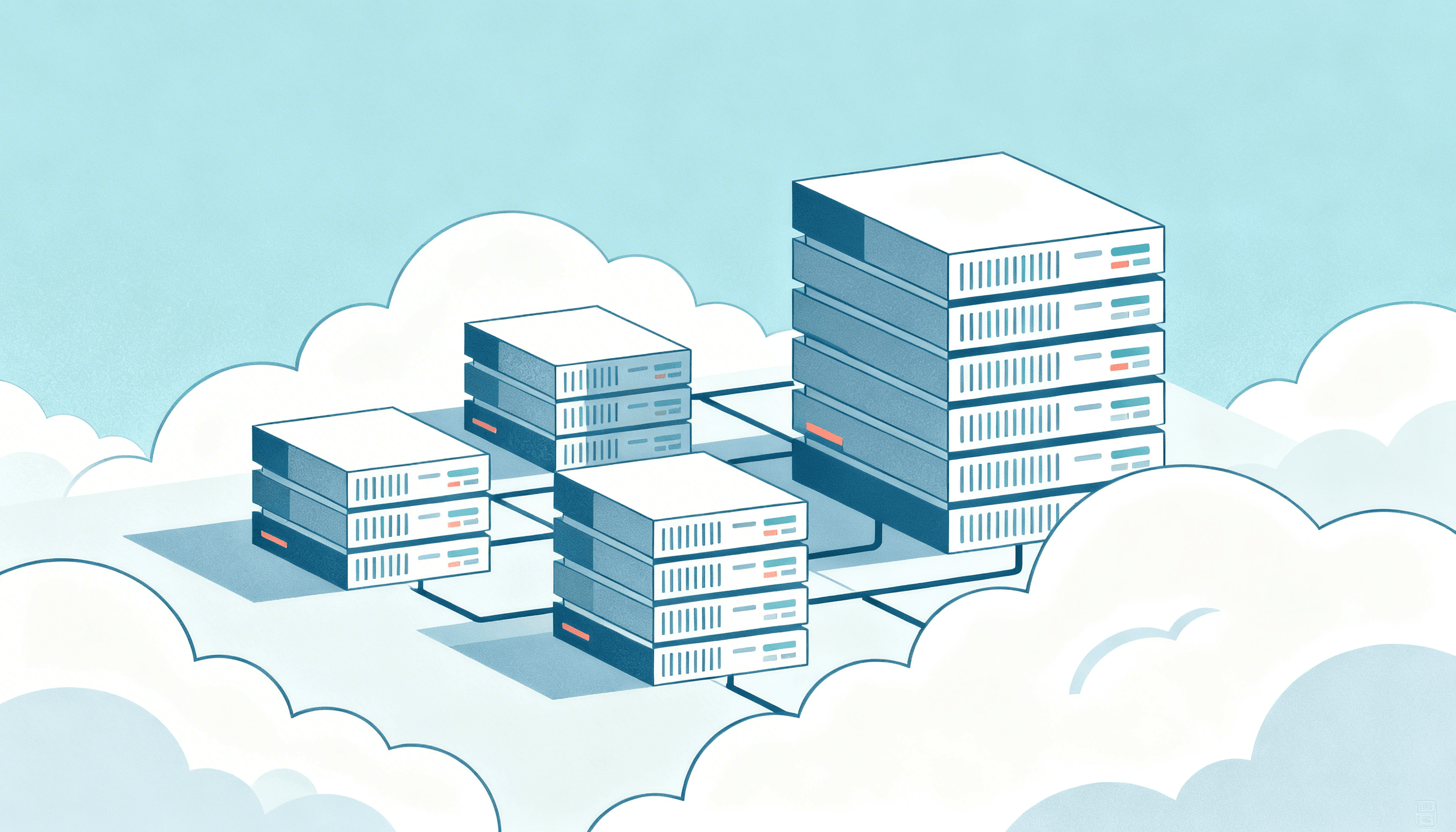

Con el crecimiento del sistema, surgió la necesidad de ejecutar tareas más complejas que requerían mayor capacidad de cómputo. Airflow, por sí solo, no estaba diseñado para manejar este tipo de cargas intensivas de manera eficiente.

Puntos clave:

Cloud Batch permitió ejecutar trabajos con recursos dinámicos, adaptándose a la carga sin afectar el sistema principal.

Para conectar ambos mundos, el equipo desarrolló operadores personalizados que permiten ejecutar trabajos de Cloud Batch directamente desde Airflow. Estos trabajos utilizan contenedores Docker, asegurando consistencia y portabilidad.

Puntos clave:

Esto permitió construir un sistema robusto donde cada componente cumple un rol específico sin generar dependencias innecesarias.

La integración de Airflow y Cloud Batch demuestra que es posible evolucionar una plataforma de datos sin reemplazar completamente su arquitectura. Al extender sus capacidades de manera estratégica, el equipo logró automatizar procesos, escalar el análisis y adaptarse a nuevas necesidades del negocio. En un entorno donde los datos son clave, construir sistemas flexibles y eficientes se convierte en una ventaja competitiva fundamental.

Glosario