El problema de la desinformación no es solo de contenido, sino de interpretación. En un entorno donde la moderación no escala al ritmo del volumen informativo, surge una alternativa: diseñar sistemas que no filtren la información, sino que ayuden a entenderla. Este enfoque llevó al desarrollo de una herramienta basada en LLM como ChatGPT, integrada en una extensión de Chrome, que analiza textos desde la perspectiva de la alfabetización mediática. Más que clasificar verdad o falsedad, el sistema introduce estructura en la lectura crítica, trasladando parte de la responsabilidad al usuario, pero con soporte asistido por IA.

Internet no tiene un problema de acceso a la información, tiene un problema de interpretación. La mayoría de soluciones actuales se enfocan en moderar contenido: eliminar, bloquear o etiquetar. Pero este enfoque tiene límites claros. No todo contenido problemático viola reglas. No toda desinformación es detectable automáticamente. Y no todo puede escalar mediante revisión centralizada. Aquí aparece una pregunta más interesante: ¿y si el sistema no intentara decidir por el usuario, sino ayudarle a pensar mejor?

A partir de esta idea, se desarrolló una herramienta experimental que utiliza modelos LLM para analizar textos en tiempo real desde una perspectiva de alfabetización mediática. No busca reemplazar el criterio humano, sino estructurarlo.

El modelo actual de consumo de información tiene tres problemas estructurales:

La alfabetización mediática no debe ser un proceso educativo aislado, sino una capacidad integrada en la experiencia digital. Los LLM permiten construir sistemas que no solo responden preguntas, sino que estructuran el análisis de información en tiempo real. Esto abre la posibilidad de pasar de un modelo de moderación a un modelo de asistencia cognitiva.

Intentar eliminar toda la información problemática es inviable. El verdadero problema es que los usuarios no siempre tienen un marco claro para interpretar lo que leen.

El problema no es lo que se publica, es cómo se interpreta.

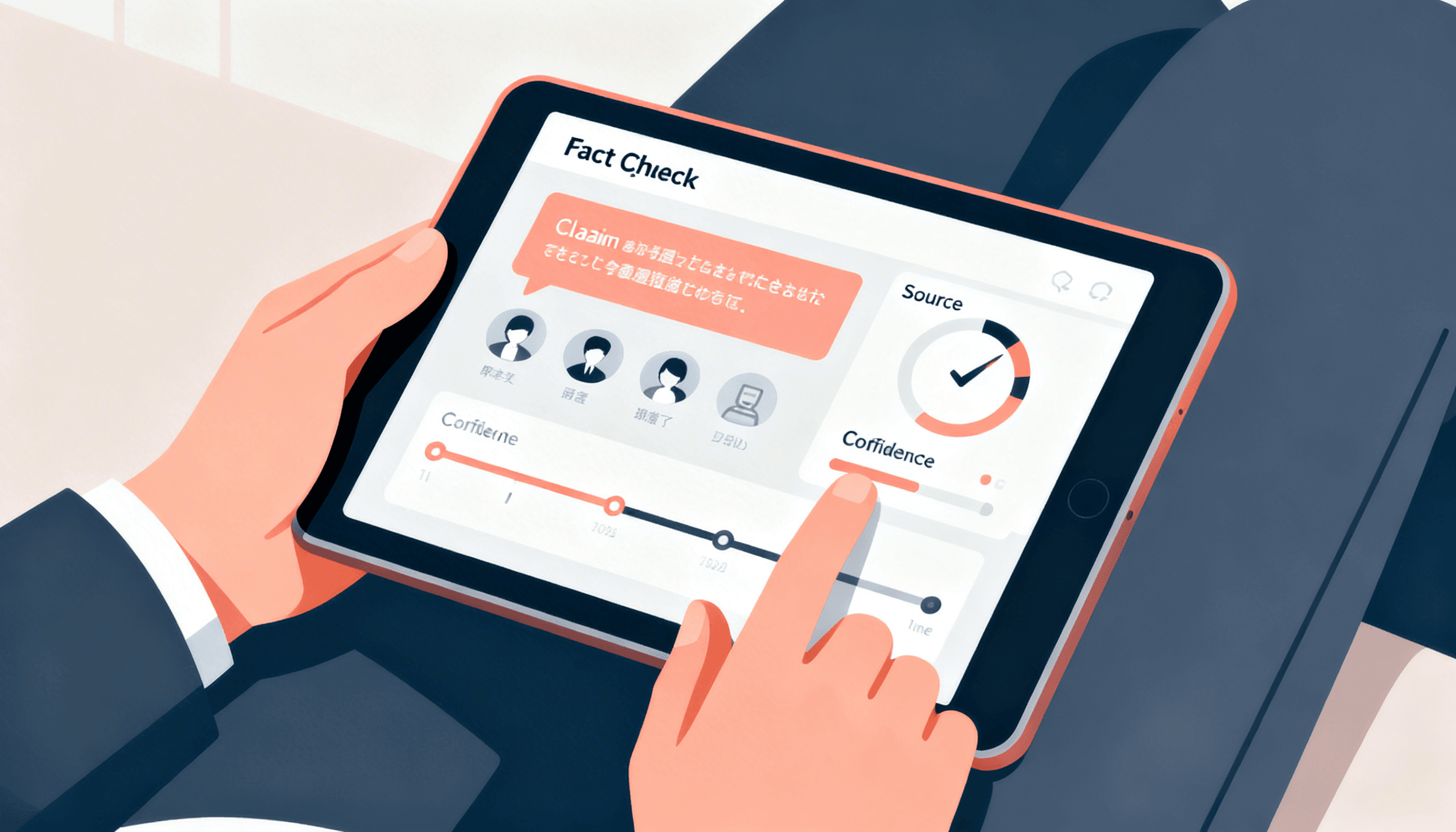

El uso de modelos como ChatGPT no se planteó como un verificador de hechos, sino como un motor de análisis estructural del lenguaje.

El sistema no responde “esto es falso”. Responde “esto debería analizarse mejor.

El valor del sistema no está solo en el análisis, sino en su integración directa en el flujo de consumo de información mediante una extensión de Chrome.

Cuando la herramienta se integra en el momento de lectura, la alfabetización deja de ser teórica y se vuelve práctica.

Como todo sistema basado en LLM, la herramienta no es neutral ni perfecta. Sus límites definen su uso responsable.

Un sistema así no elimina el problema, lo redefine.

La moderación de contenido es una solución necesaria, pero insuficiente. No puede escalar al ritmo de la información ni cubrir todas sus formas. El verdadero cambio está en diseñar sistemas que aumenten la capacidad crítica del usuario. Esta herramienta demuestra que los LLM pueden ser utilizados no solo para generar contenido, sino para estructurar la forma en que lo analizamos. Pero también deja claro que la responsabilidad no desaparece: se redistribuye.

Escalar en la era de la información no es controlar lo que se dice, es mejorar cómo se entiende.